DeepFake Forensics®

ディープフェイクフォレンジック™️(DeepFake Forensics™️)とは、ディープフェイク技術によって作成された映像や音声の真偽を判断し、人工的に作り出される痕跡を検出してその信頼性を評価するための技術や手法のことを指します。具体的には、ディープフェイクフォレンジックは、映像や音声の特徴を分析し、その信頼性や真偽を判定するための様々な手法を用います。たとえば、映像のピクセルや音声の波形の解析、映像や音声の特徴量の抽出、深層学習を用いたパターン認識、映像や音声の調整・比較などがあります。近年、ディープフェイク問題に取り組んでいるメディアも増えてきています。ニュースやビデオの信頼性を高めるために、ディープフェイク検出技術を使用するなど、様々な対策を講じています。

また、社会的な取り組みとして、各国政府や国際機関、民間団体などがディープフェイク問題を扱っています。アメリカ合衆国の国家安全保障局は、「ディープフェイクニュース対策プログラム」を開始し、欧州連合も同様の動きがあります。

しかしこれらは、メディアフォレンジック(Media Forensics)と呼ばれ、多くは、フェイクニュースによって報じられた内容の真正を検証するものであって、発信者が誰でどのような組織の支援の下に行われているのかを調査し、発信されている文字情報、画像、音声、動画像、音声つき動画像が加工されていないかなどには言及されていません。こうした加工が施されていないかまでも検証を踏み込んでいくディープフェイクフォレンジック技術への期待が高まっています。

ディープフェイク技術は、悪用される可能性があるため、社会的な問題を引き起こす可能性があります。例えば、政治的なフェイクニュースや、セレブリティの顔を合成したポルノグラフィーの製作などが挙げられます。

-

フェイクの映像によるトランプ大統領の演説

2018年には、DeepFake技術を使用したフェイクの映像がオンラインで拡散されました。この映像では、トランプ大統領の演説が偽物であることを示しています。

-

ガル・ガドットさんの顔を使ったポルノ映像

2018年には、女優のガル・ガドットさんの顔を使用したポルノ映像がオンラインで拡散されました。

-

マーク・ザッカーバーグの偽動画

2019年には、マーク・ザッカーバーグの偽動画が公開されました。この動画では、ザッカーバーグ氏がFacebookの支配的地位を認め、個人情報を売り払っているかのように話しているように見えます。

-

プリンス・ハリーとメーガン妃のフェイクのインタビュー

2021年には、BBCのニュース番組で、プリンス・ハリーとメーガン妃のインタビューがフェイクであるとの疑惑が浮上しました。インタビューの一部が編集されたり、音声が加工されたりしていたためです。

-

オバマ大統領の演説

2018年には、人工知能を使用して作成されたオバマ大統領の偽の演説映像が広がりました。この映像は、リップリーディング技術を使用してオバマ大統領の口の動きを再現したものでした。

-

クイーンエリザベス2世の演説

2020年4月には、クイーンエリザベス2世の偽の演説が広がりました。この映像では、クイーンエリザベス2世が新型コロナウイルスに対する国民へのメッセージを伝えるように見えます。

さらに、架空のデータを利用して、科学的研究や学術論文を偽造したり、偽の研究結果を報告したりする行為を指します。フェイクデータは、研究の信頼性や正確性を損ない、社会的な問題を引き起こすことがあります。

例えば、2011年には、東京大学の研究グループが、幹細胞の研究において、フェイクデータを使用していたことが判明しました。この事件は、研究界に大きな衝撃を与え、研究倫理の重要性が再認識されることになりました。

また、2020年には、米国の大手科学誌『Science』に掲載された論文が、フェイクデータを使用していたことが明らかになりました。この論文は、新型コロナウイルスに対する抗体を発見したと報告していたものでしたが、実際にはデータの不正操作が行われていたことが判明しました。

このようなフェイクデータ事件は、科学研究や学術界において信頼性を損ね、社会的な問題を引き起こすことがあるため、研究倫理の重要性です。

このような背景から、ディープフェイクフォレンジックが必要とされるようになりました。ディープフェイクフォレンジックは、人工知能技術を駆使して、ディープフェイクの判別や解析を行うことで、ディープフェイクの検出や削除、および作成されたデータの信頼性を判断することができます。

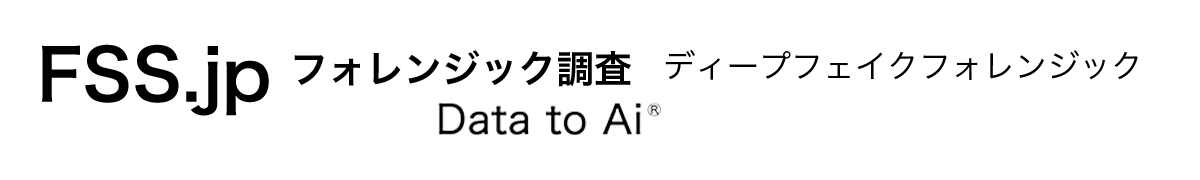

ディープフェイクフォレンジックは、以下のような分野で必要とされています。

- ニュースメディア:政治的なフェイクニュースの発生防止や、信頼性の高い報道を行うために、ディープフェイクの検出が必要とされます。

- 法執行機関:証拠の偽造を防ぐために、ディープフェイクの検出や、ディープフェイクが使用された事件の調査が必要とされます。

- エンターテイメント産業:セレブリティの顔を合成したポルノグラフィーの製作防止や、作品の信頼性向上のために、ディープフェイクの検出や解析が必要とされます。

- セキュリティ対策:ディープフェイク技術を用いたサイバー攻撃の防止や、フィッシング詐欺の予防に、ディープフェイクの検出が必要とされます。

有名人を使ったフェイクデータ事件では、有名人の名誉を毀損するだけでなく、社会的な問題を引き起こす可能性があるため、真偽を確認することが重要です。また、こうした事件は、ディープフェイク技術を使用することによる危険性を再認識されました。

-

偽ゼレンスキー大統領画像調査

SNSで偽のゼレンスキー大統領が降伏を呼びかける動画が拡散されました。この動画は、ディープフェイクで作成されたものでした。実際に偽動画と本物の動画を比較すると、本物のゼレンスキー大統領の動画は、首に影が写っていますが、実際にディープフォレンジック調査を行ったところ、偽物のゼレンスキー大統領の動画には、首に影が写っていないことで、動画の中で顔部分だけが合成していることが判明しました。

例えば、2011年には、東京大学の研究グループが、幹細胞の研究において、フェイクデータを使用していたことが判明しました。この事件は、研究界に大きな衝撃を与え、研究倫理の重要性が再認識されることになりました。

また、2020年には、米国の大手科学誌『Science』に掲載された論文が、フェイクデータを使用していたことが明らかになりました。この論文は、新型コロナウイルスに対する抗体を発見したと報告していたものでしたが、実際にはデータの不正操作が行われていたことが判明しました。

このようなフェイクデータ事件は、科学研究や学術界において信頼性を損ね、社会的な問題を引き起こすことがあるため、研究倫理の重要性です。

このような背景から、ディープフェイクフォレンジックが必要とされるようになりました。ディープフェイクフォレンジックは、人工知能技術を駆使して、ディープフェイクの判別や解析を行うことで、ディープフェイクの検出や削除、および作成されたデータの信頼性を判断することができます。

2021年に発表されたGrand View Researchの調査によると、2028年までにディープフェイクフォレンジック市場の年間成長率は年平均27.2%と予測されています。また、同調査によると、2020年の市場規模は1億4,400万ドルであり、2028年までに約6億6,900万ドルに拡大すると予測されています。

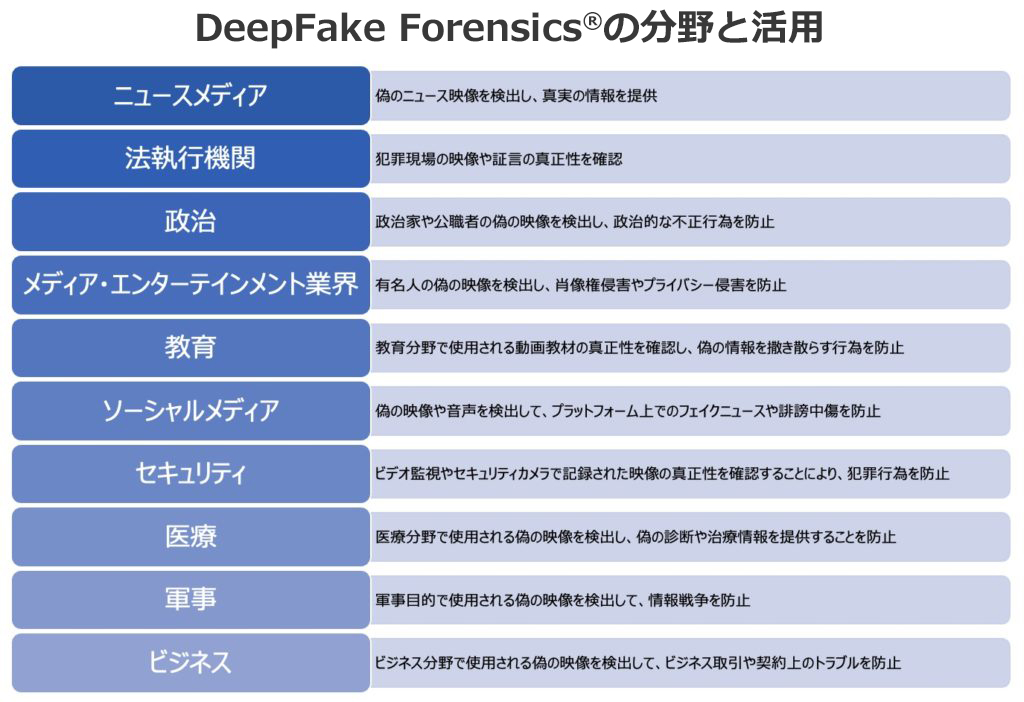

ディープフェイクフォレンジックの主な流れは次のようになります。

-

データ収集

検証する映像や音声データを収集します。データの収集には、オリジナルの映像や音声データ、および疑わしいDeepFake映像や音声データが含まれます。

特定されたメディアファイルを収集し、可能であれば、作成された日時や作成者、共有元など、メタデータも収集します。 -

データ解析

解析ツールを使用して、映像や音声データを検証します。検証には、DeepFakeが使われているかどうかを特定するために、様々な手法を使用します。DeepFakeで生成された映像の場合、データの中に生成元として使用された複数の画像が含まれていることがあります。

ディープフェイクを作成するために使用される可能性のあるツールを特定します。これには、ニューラルネットワークや深層学習モデルなどが含まれます。また、そのツールを使用するために必要な技術的なスキルや知識も特定します。

【テクスチャ解析】

ディープフェイクのテクスチャ解析を行います。これは、画像の解像度を高くしたり、テクスチャのパターンを分析したりすることで、画像の本来の特徴を抽出することができます。

【フェイスマッチング】

元の映像や画像を特定するために、ディープフェイクの顔のマッチングを行います。これには、画像やビデオフレームを分析し、ディープフェイクに使用された顔と似た顔を持つ人物を特定することが含まれます。 -

特徴検出

DeepFakeを作成する際に使用された特徴を検出します。対象者の表情、口の動き、声のトーン、背景音などが使用されることがあります。

ディープフェイクである可能性があるメディアファイル(動画、画像など)を特定します。これは、不自然な映像や不自然な動き、顔や体の動きのずれ、顔の輪郭線の異常、音声の変化などを確認することで行います。

【背景の特定】

DeepFakeは、オリジナルの映像から切り抜かれた人物を別の背景に貼り付けることで作成されます。背景の特定を行うことで、DeepFakeである可能性があるかどうかを判断することができます。

【顔の特定】

DeepFakeでは、人物の顔がデジタル処理され、他の人物の顔に置き換えられることがあります。顔の特定を行い、オリジナルの顔と異なる点を特定することで、DeepFakeである可能性があるかどうかを判断することができます。

【声の特定】

DeepFakeの音声は、元の音声を加工して作成されます。音声の特定を行い、オリジナルの音声と異なる点を特定することで、DeepFakeである可能性があるかどうかを判断することができます -

モデルトレーニング

DeepFakeを検出するために、検出アルゴリズムをトレーニングします。トレーニングには、DeepFakeを作成する際に使用される特徴を学習するために、ディープラーニングや機械学習を使用することがあります。

-

詳細分析

ディープフェイクの作成方法、作成者、および使用された技術的な手法などを特定します。この段階では、異常なノイズ、フレームの飛び、コンテキスト不一致などを確認し、ディープフェイクであることを特定することができます。

-

検証結果の報告

検証結果を報告し、偽の映像や音声を特定します。また、偽の映像や音声が発見された場合には、その影響を評価し、必要に応じて適切な措置を取ります。

ディープフォレンジックの流れ

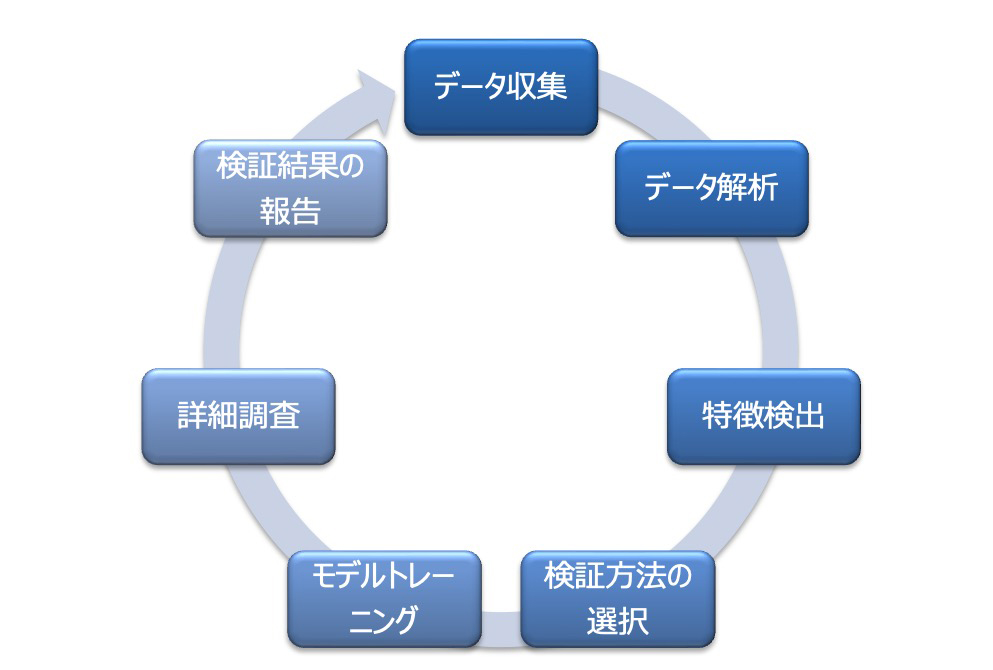

弊社では、これまでは人間のためのデータのリスクを管理してきました。しかし、これからはAIのためには必ず学習用データが必要で、このAIのためのデータのリスク管理、保存管理、データを総合的に集めて管理することがキーになります。AIのためのAIデータのリスク管理に注力をし、AIデータを活用した、AIデータドリブン事業の支援をして参ります。